2002-04-18[n年前へ]

2003-04-18[n年前へ]

■学研のガチャガチャ

科学の付録のミニ版をユージンがガチャガチャに。

2004-04-18[n年前へ]

■「ATOK Perlプラグイン(ruby,awk,その他大勢)」インストール編

AmetPerlを使ってみたけれど、「(使ってみたい気もするけれど)ウチの環境でOKなのかしら?無理っぽいかも?」とお思いの方。最低限必要なのはATOK on WindowsのVer.12以降だけです。ATOKがないなら…、うーんオンライン版を買っちゃいましょうか、6000円位だし…。あとは、AmetMulti(旧名称AmetPerl)をインストールして、チョコチョコと設定をすれば良いです。

perlやrubyやawkや…もあればおそらくとても便利だと思いますが、それらは絶対必要なものではありません。気が向いた時に、好きなものをインストールするのが吉か、と思います。それらのインストールも全く難しいことではないですしね。

(もし、ATOKを持っていてインストールしてみる気になりましたら)できましたら、その過程をちょこっと何処か(何処が何処かは教えて頂くものとして)に書いて頂くなり、メールでその過程を送って頂けたら幸いです。

■服を透けて見通すことができるCOLOR X-RAY VISION

服を透けて見通すことができるCOLOR X-RAY VISION。こんなものをかけていたらアヤシ過ぎる。

服を透けて見通すことができるCOLOR X-RAY VISION。こんなものをかけていたらアヤシ過ぎる。

それにこれはただの透け透け水着ナイトビジョン。グラスビジョンに格安CCDをつけただけ。銀色のサングラスの内側に隠されたCCDのレンズの前には黒い可視光カットフィルターがついているに違いない。しかし、発想は下らなくバカバカしくも、なんとも妙に面白いかも。 from tekstasy

■Microsoft Visual C++ Toolkit 2003配布

The Microsoft Visual C++ Toolkit 2003 includes the core tools developers need to compile and link C++-based applications for Windows and the .NET Common Language Runtime.from 電波…とどいた?

■SAMIE Simple Automated Module For Internet Explorer

Samie allows you to write perl scripts in order to drive Internet Explorer all over the web というSAMIE.

■漢字アートの安室奈美恵

AmetMultiにオマケ添付されている「漢字アート」コマンド・プログラムの使い方をメモしておきます。

AmetMultiにオマケ添付されている「漢字アート」コマンド・プログラムの使い方をメモしておきます。

使い方は、以下のようになります。出力ファイルは元Bitmapファイル名に".bmp"が付加されたものになります。ノイズ数は擬似輪郭を見えにくくするためにかけるホワイトノイズの量です。30〜10位が適当でしょうか。オマケ用に作ったものですけれども、そこそこ高画質だと思います。ちなみに、漢字の変換テーブルは「漢字で絵を描く」のものを流用しながら少し変えたものを使っています。もしも、自分で変更したかったら付属のLUT.TXTを適当にいじってみて下さい。

kanjiart.exe 元Bitmapファイル名 幅の文字数 ノイズ数

■「就寝時間・起床時間・睡眠時間」空間における「春眠暁を覚えず」

「就寝時間・起床時間・睡眠時間」の三次元空間における「ぼくの睡眠パターン」をプロットし、「7時間睡眠平面」と重ね合わせることで、「春眠暁を覚えず」をグラフにして実感してしまうことができる「1日の平均睡眠時間は7時間5分32秒」

「就寝時間・起床時間・睡眠時間」の三次元空間における「ぼくの睡眠パターン」をプロットし、「7時間睡眠平面」と重ね合わせることで、「春眠暁を覚えず」をグラフにして実感してしまうことができる「1日の平均睡眠時間は7時間5分32秒」

2005-04-18[n年前へ]

■興味のベン図

昨日はTech総研の原稿を締め切りより早めに書いたわけである。ただ、順番が私の前のたださんと「これは重なるよなぁ…きっと」というものがあったので、ちょっと担当の方にメールを出して訊いてみた。すると…、やっぱり重なっていた。というわけで、原稿チョット書き直し。

ちなみに、質問メールにラクガキのように書いた私の勝手な印象はこんな感じ。

そうえいば、私が興味を惹かれる記事はオリバーさんとかなり重なることがわかりました。ちょっと仕事よりになると、たださんと重なって、わくたまさんとはあまり重ならない…、という感じです。 で、勝手な想像をすると、「私の興味とオリバーさんの興味の重ならない部分」がちょうど「オリバーさんの興味とわくたまさんの興味の重なっている部分」という感じのような…。そして、その返事に書かれていた「これまでに重なり合ってしまった記事」を見ると、「それぞれの興味のベン図」が描けそうで面白いかも。

2008-04-18[n年前へ]

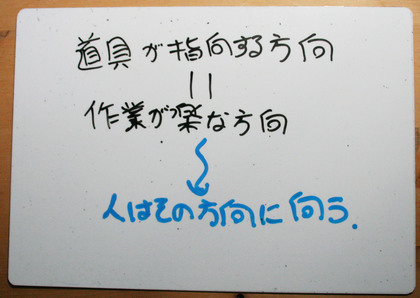

■「自分で作った道具」で「自分が作るもの」と「クラス分け」

よく、「使う道具次第で、作る内容は違ってくる」と言われる。インターネット上の道具で言えば、ネット関連の日記ツールの「指向性」次第で、そのツールを使って書かれる内容は異なってくる、と言われる。もしも、繋がりを作るのが容易なツールであれば、繋がりを意識した内容になるだろうし、「意識して作業しなければ繋がりが作られないツール」を使うのであれば、あまり繋がりを意識した内容にはならない。コメントを重視した道具であればコメント主体になるし、コンテンツ志向の道具であれば、当然コンテンツが充実してくる。それは、自然なことだと思う。

なぜそれが自然かと言うと、多くの場合、道具が指向する方向を、それを使う人は意識するからだろう。その道具が得意な方向に、つまり道具が導く流れの(一言で言ってしまえば楽に作業できる)方向に、人の努力は向かう。だから、「使う道具次第で、作る内容は違ってくる」のだと思っている。

なぜそれが自然かと言うと、多くの場合、道具が指向する方向を、それを使う人は意識するからだろう。その道具が得意な方向に、つまり道具が導く流れの(一言で言ってしまえば楽に作業できる)方向に、人の努力は向かう。だから、「使う道具次第で、作る内容は違ってくる」のだと思っている。

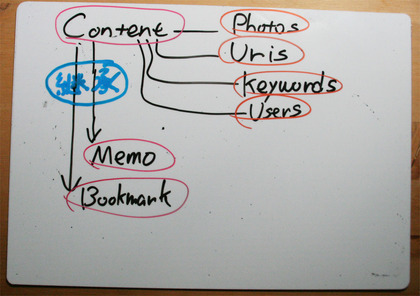

少し前に、サーバアプリを(静的HTML+hns(hyper nikki system)から自作ツールに変えた時、つまりWEBサーバ側のコンテンツ作成ツールを開発しようとした際には、WEBサーバに「どんな内容のことを書き連ね・どんなものを溜めている(溜めたい)のだろうか」ということを考えた。「使う道具次第で、作る内容は違ってくる」のが真実だとしたら、どんな「道具を作るべきなのか=どんなことを(その道具を使って)作りたいのか」を考え直す作業をした。

「自分が何かを書くために、そのためのツールを作る」というのはとても新鮮な作業だった。なぜなら、結局のところ、それは「自分が何をしたいのか」ということを考える作業でもあったからだ。

「自分が何かを書くために、そのためのツールを作る」というのはとても新鮮な作業だった。なぜなら、結局のところ、それは「自分が何をしたいのか」ということを考える作業でもあったからだ。

サーバアプリはRailsを使って適当に作った。その構造を大雑把に言えば、画像アップロード・他サイトリンク(リンク先サムネイル作成/全文キャッシュ)などの機能を備えたContentクラスを作り、Contentクラスを継承して、Articleクラス(できるかな?)とMemoクラス(inside out)とBookmarkクラス(現状Tech-logs)があり、それら全てのContentを継承したクラス間をKeywordクラスが(Keywordクラス自身も含め)繋いでいる、という具合である。そういったクラス継承に頼った道具の造り・構造は、Ruby on Railsという道具をさらに使ったためである。(また、デザイン/CSSはtDiary系互換にし、自分でそういった作業をすることは止めた。)

Article(できるかな?)とMemo(inside out)とBookmark(現状Tech-logs)

という各クラス分けされた道具に影響され、それまでとは書く位置づけ・方向性はやはり異なってきたように思う。inside outからは、コメント程度のBookmark的要素(現状Tech-logs)が消え、その分、Articleクラス(できるかな?)に近づき、Articleクラスからは、Memoクラス(inside out)的に書いた小品は消える、という具合だ。

Article(できるかな?)とMemo(inside out)とBookmark(現状Tech-logs)

という各クラス分けされた道具に影響され、それまでとは書く位置づけ・方向性はやはり異なってきたように思う。inside outからは、コメント程度のBookmark的要素(現状Tech-logs)が消え、その分、Articleクラス(できるかな?)に近づき、Articleクラスからは、Memoクラス(inside out)的に書いた小品は消える、という具合だ。

とりあえず、自分のために作ったツールだから、自分が使うためには一番いい。けれど、クラス分けし過ぎたような気にもなる。本来、曖昧な境界線しかないものを、別なものとしてクラス分けしたことの弊害が、きっとどこかに出てくるに違いない。キーワードでその分離を補うことを狙ったのだけれど、キーワード連携ではどうやら力不足のようだ。

2009-04-18[n年前へ]

■RubyのArrayクラスに法線・法線角度・ヒストグラム算出メソッドを追加する

体を使った運動では、運動をしない期間が続くと、必ず体を思うように動かすことができなくなります。それと同じように、頭を使った運動でも、(自分自身の頭と”手を”動かすような)運動をしない期間が生じると、悲しいほどに「頭の運動能力・バランス感覚」が劣化してしまうものです。逆にいえば、「頭の運動能力・バランス感覚」を保てるかどうかは、自分自身の頭と”手を”動かし続けているか否か、だと思っています。

ふと気づくと、Rubyのコードを1月くらい書いていません。そこで、RubyのArrayクラスで法線・法線角度・ヒストグラムを算出することができるメソッド・コードを書いてみました。たとえば、下のようなコードを書くと、二次元配列を表面形状と考えた上で(XYのメッシュ間隔は horizontal_resolution により定義します)、その法線が天頂となす角度を計算し、さらに0~90度までのヒストグラムを作成し、出力することができます。Rubyで法線算出などをしたいという人は少ない(というよりほとんどいない)とは思いますが、ニッチということは希少ということでもあるわけで、参考までにここに書いておきます。

require 'pp'

a=[[0,0,0],

[0,1,0],

[0,0,0]]

pp a.normalVector(1).slopeDegree.histogram

ソースコードは下のようになります。不具合などありましたら、教えて頂ければ幸いです。

class Array

# jun hirabayashi jun@hirax.net

# http://www.hirax.net/

# 2009.04.19

include Math

def normalVector(horizontal_resolution)

# horizontal_resolution=size of xy mesh

normal_vector=[]

ysize=self.length

xsize=self[1].length

(ysize-1).times{|y|

normal_vects_line=[]

(xsize-1).times{|x|

v1=[0,horizontal_resolution,

self[y+1][x].to_f-self[y][x].to_f]

v2=[horizontal_resolution,0,

self[y][x+1].to_f-self[y][x].to_f]

a_norml_vec=[(v1[1]*v2[2]-v1[2]*v2[1]),

(v1[2]*v2[0]-v1[0]*v2[2]),

-(v1[0]*v2[1]-v1[1]*v2[0])]

length=sqrt(a_norml_vec[0]*a_norml_vec[0]+

a_norml_vec[1]*a_norml_vec[1]+

a_norml_vec[2]*a_norml_vec[2])

a_norml_vec=[a_norml_vec[0]/length,

a_norml_vec[1]/length,

a_norml_vec[2]/length]

normal_vects_line<<a_norml_vec

}

normal_vector<<normal_vects_line

}

return normal_vector

end

def slopeDegree

slope_degrees=[]

self.each{|line|

slope_degrees_line=[]

line.each{|val|

theta=1.0*val[2]*360.0/(2.0*PI)

slope_degrees_line<<theta

}

slope_degrees<<slope_degrees_line

}

return slope_degrees

end

def histogram

histo=Array.new(90){0}

self.each{|line|

line.each{|val|

deg=val.to_i

if 0<=val && val<90

histo[deg]+=1

end

}

}

return histo

end

end

2010-04-18[n年前へ]

■「さがしもの」は何ですか?見つけにくいものですか?

何年か前、「自分探し」が流行った。「自分」というものがどういうものなのか、よくわからないままに、そんなよくわからない「自分」というものを探すブームがあったような気がする。

何年か前、「自分探し」が流行った。「自分」というものがどういうものなのか、よくわからないままに、そんなよくわからない「自分」というものを探すブームがあったような気がする。

何かを求める人がいるなら、何かに対するニーズがあるのなら、つまり、需要があるのなら、そこに供給者が現れる、というのがよくある状況だと思う。

自分を探す人が数多くいるのなら、「(その人たちが求める)自分」を、よりどりみどりに並べ売る、そんな供給者が現れるに違いない。そんな「自分」を売る店は、さぞかし繁盛するに違いない。「自分」というものは、きっと売れる「商材」に違いない。

…と、そんな風に考えてみると、本屋に並ぶ自己啓発本は、まさにそんな「(その人が求める)自分」を売る本であるかのように思えてくる。本屋に並ぶ本の多くは、自分探しをする人のために、「その人が求める自分」を提供するための本なのかもしれない。それを、言い換えるなら、本屋で私たちがそんな本を手に取るとき、無意識のうちに(かつて流行った)「自分探し」をしているのかもしれない。

「自分探し」ブームの頃、同時に、「自分隠し」ブームも流行っていたような気がする。「自分隠し」ブームというものがあったとしたなら、そこには一体どんなものを供給するものが現れるのだろう。何かを隠す森のようなものを供給するものが現れるのだろうか。

「自分探し」ブームの頃、同時に、「自分隠し」ブームも流行っていたような気がする。「自分隠し」ブームというものがあったとしたなら、そこには一体どんなものを供給するものが現れるのだろう。何かを隠す森のようなものを供給するものが現れるのだろうか。

それとも、供給者でない何かが、そこでは必要とされるのだろうか。

2011-04-18[n年前へ]

■「南国のドラえもん」と「四次元ポケット」

一年前、占拠状態の街にいるドラえもんを不思議な心地で眺めていました。たくさんの赤と若干の黒シャツを着た人たちが溢れる占拠地の中心集会所地区で、重要個所を守る警備員も(占拠地帯で占拠を続ける親戚たちと共に遊ぶ)こどもたちも、どちらも同じようにドラえもん銃を持ち、同じように気まぐれに水鉄砲をこっちに向けて、水をピューっと掛けてきたりします。

一年前、占拠状態の街にいるドラえもんを不思議な心地で眺めていました。たくさんの赤と若干の黒シャツを着た人たちが溢れる占拠地の中心集会所地区で、重要個所を守る警備員も(占拠地帯で占拠を続ける親戚たちと共に遊ぶ)こどもたちも、どちらも同じようにドラえもん銃を持ち、同じように気まぐれに水鉄砲をこっちに向けて、水をピューっと掛けてきたりします。

灼熱の太陽の下で、熱せられたコンクリートの上に座り込みを続ける人たちをずっと眺めていると、興味深いことに気づきます。地球が回り、太陽が空を動く…その動きにしたがって横断歩道やビルの陰は少しづつ動いていきます。そして、彼らは灼熱の太陽の下ではなくて動くビルの陰の上にいて、少しづつ動く陰と同じように彼らは座り込む場所を動かしていくのです。建物の陰がちょっと動くと、その陰に座る人たちもちょっと座る位置を変えていき、そして数時間も経てば、みな全然違う場所に座りこみをしているのでした。

灼熱の太陽の下で、熱せられたコンクリートの上に座り込みを続ける人たちをずっと眺めていると、興味深いことに気づきます。地球が回り、太陽が空を動く…その動きにしたがって横断歩道やビルの陰は少しづつ動いていきます。そして、彼らは灼熱の太陽の下ではなくて動くビルの陰の上にいて、少しづつ動く陰と同じように彼らは座り込む場所を動かしていくのです。建物の陰がちょっと動くと、その陰に座る人たちもちょっと座る位置を変えていき、そして数時間も経てば、みな全然違う場所に座りこみをしているのでした。

街を眺めれば、いたるところにドラえもんがいます。町中に溢れ・人を眺める仏像のように、たくさんのドラえもんたちが人々の中に溢れていました。そのドラえもんを印象深く感じながら、表現する言葉を見つけられないままに、一年経ってしまいました。

街を眺めれば、いたるところにドラえもんがいます。町中に溢れ・人を眺める仏像のように、たくさんのドラえもんたちが人々の中に溢れていました。そのドラえもんを印象深く感じながら、表現する言葉を見つけられないままに、一年経ってしまいました。

今、あの南国からドラえもんが日本に帰ってきたとしたら、四次元ポケットからどんなものをとり出すのだろう、と考えます。色々なものが現れた後で、四次元ポケットに残ったただひとつのものは、もしかしたら「希望」という名前なのかもしれないとも、ふと思います。

2013-04-18[n年前へ]

■「○×な視覚で□△を眺めた・出力した結果」を知能検索エンジンWolfram Alphaに訊いてみよう!?

Wolfram Researchが提供する知識検索エンジン Wolfram Alpha で「人間を含む動物の視覚処理(風な)」機能が使えるようになっています。光スペクトルを識別するための光受容体数と空間分解能を非常に大雑把に模した画像処理を、Wolfram Alpha上で行うことができるようになっています。

Wolfram Researchが提供する知識検索エンジン Wolfram Alpha で「人間を含む動物の視覚処理(風な)」機能が使えるようになっています。光スペクトルを識別するための光受容体数と空間分解能を非常に大雑把に模した画像処理を、Wolfram Alpha上で行うことができるようになっています。

たとえば、「犬がスーパーマンを見るとどう見えるか?(apply dog vision to image of superman)」を調べてみると、こうなります。左下が元画像で、右下が処理結果です。

ちなみに、「スーパーマンの画像をマンガ風に描いた画像変換を掛ける(=apply dog vision to image of superman)」と右の画像のようになります。これは、フルカラーの階調画像を二値的にハーフトーニング(中間調処理)する、つまり、人間や動物ならぬ機械の出力特性に沿った(非常に大雑把な)変換画像を作る機能です。

ちなみに、「スーパーマンの画像をマンガ風に描いた画像変換を掛ける(=apply dog vision to image of superman)」と右の画像のようになります。これは、フルカラーの階調画像を二値的にハーフトーニング(中間調処理)する、つまり、人間や動物ならぬ機械の出力特性に沿った(非常に大雑把な)変換画像を作る機能です。

「○×な視覚で□△を眺めた・出力した結果」を知能検索エンジンWolfram Alphaに訊いて・眺めてみると、新鮮な世界を眺めることができるかもしれません。

2014-04-18[n年前へ]

■「ニコニコ超会議3」の「ニコニコ学会β 研究してみたマッドネス」でお待ちしてます

来週末4月26日(土)・27日(日)に幕張メッセで開催の「ニコニコ超会議3」のイベントのひとつ、「ニコニコ学会β 研究してみたマッドネス」で27日(日)に研究報告をします。新作も交えて(そうでなければつまらないし、そうしたいものだし)、3分ばかりの研究報告をするつもりです。

来週末4月26日(土)・27日(日)に幕張メッセで開催の「ニコニコ超会議3」のイベントのひとつ、「ニコニコ学会β 研究してみたマッドネス」で27日(日)に研究報告をします。新作も交えて(そうでなければつまらないし、そうしたいものだし)、3分ばかりの研究報告をするつもりです。

27日(日)の13:00〜14:30 が本番「研究報告タイム」で、それとは別に、その前後の時間

・12:00-12:30魔術師たちのオフィスアワー3

・14:30-15:00魔術師たちのオフィスアワー4

にも、観客席後方で交流&サインOKという「誰にも知られてない」野生の研究者にとっては、なんか辛そうな(まるでAKB握手会で研修生が味わうような)壁の花タイムも過ごす予定です。

15の発表の12番目が私の研究報告「15歳のときに知っておきたかった科学 〜 拝啓 ○×△が好きな十五の君へ」です。その後には、さらに超面白そうな、「DIY音響浮揚装置を作ってみた」「宇宙エレベーターモデル昇降機の開発」「日吉で跳んでみた 高度100mぐらい」と楽しい時間が続くので、お暇な方はぜひ遊びに来て下さい。

世界各地に生息する野生の研究者の方々に、取り組んでいる研究を存分に発表していただく場です。発表時間は3分。その短い時間に熱い想いが凝縮された研究発表をお楽しみ下さい。

『第6回・研究してみたマッドネス』

2015-04-18[n年前へ]

■自転車王国で「逆向き乗り2人乗り自転車」を見てビックリするの巻

「自転車王国」に行って驚いたのが、自転車乗りの「平均レベル」が全然違うということでした。たとえば、空気抵抗がCd 0.1くらいになりそうな全高50cmくらいの(中にいるはずの人の気配を全く感じることができない不気味な)超完全風防付きリカンベント自転車が、商店街を(やはり)超高速で走り抜けていたり、全自動の(どうやってバランスをとっているのか全く分からない)一輪車自転車が高速で走っていたりします。

そんな自転車くらいなら「ヘン」の一言で済ますこともできるのですが、こんな2人乗りのタンデム自転車が横を走ってたりすると、かなり反応に困ります。ちなみにこの自転車、進行方向は「左向き」です。右側に位置する女性のハンドルは固定されていて、自転車の向きを変えることはできません。つまり、ある種の結論は、「自転車王国をあなどってはいけない」「何より、後ろ(反対)向きで自転車に乗り、バランスを上手くとる後ろの女性(たち)が何より凄い」かと思われます。

2017-04-18[n年前へ]

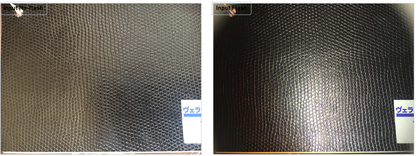

■たった2枚のスマホ写真から、自動でリアルなCG素材を作ってみよう!?

スマホを使って、(スマホ付属のライト点灯有無による)2枚の撮影画像から対象物の素材情報(反射特性や凹凸分布)をキャプチャする研究があります。原理は単純で、一般的に照明光が方向性を持つ普通の環境下で撮影した写真からは、同じ方向を向く領域が抽出できるし、照明ライトを点けた写真からは、(撮影画像内の各領域に対する)照明方向と撮影方向がわかるので、それらを組み合わせると、色んな情報がわかるよね!という内容です。…その研究内容が、最近NVIDIAサイトで最近WEBサービス(Photo To Material: 2shot)化されました。

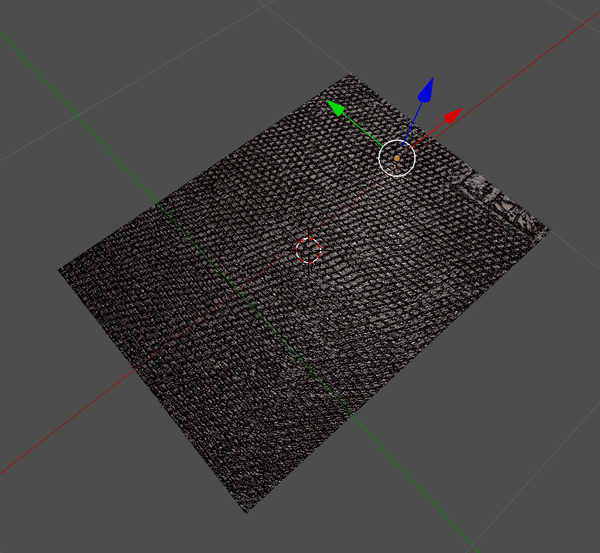

これは面白そう!というわけで、使ってみた結果が下のようになります。左2枚の写真が、黒皮的な素材をスマホで撮影した画像で、右の画像がWEBサービス(Photo To Material: 2shot)で生成された素材データを使ってCGレンダリングした画像です。…わかりにくいかもしれませんが、たった2枚のスマホ撮影画像から、対象物の色や3次元形状などが得られていることがわかります。

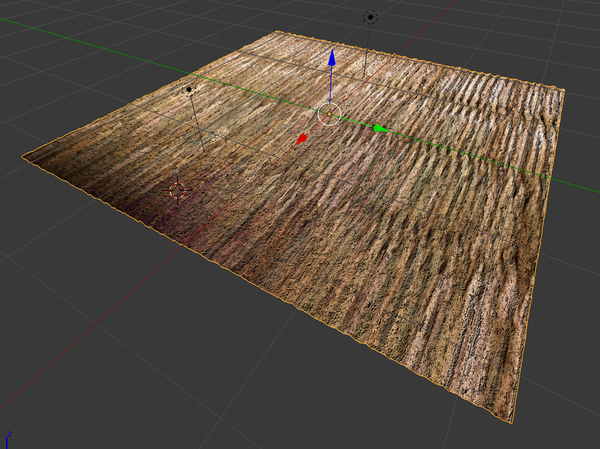

ためしに、畳をスマホで撮影して・その撮影画像から生成した素材データを使ってCGレンダリングを行ってみると、下の画像のようになります。…わかりにくいかもしれませんが、3次元情報や色やさまざまな情報が得られていることがわかります。

処理可能な撮影対象は、(規則的である必要は無いのですが)似たような模様が繰り返されているパターンに限られます。けれど、目の前にある素材を「記録」して「CGなどで使ってみたくなる」ことも多い…かもしれません。そんな時、このNVIDIAのサービスはとても役立つに違いない!というわけで、もう少し遊んでみようと思います。

2019-04-18[n年前へ]

■歴史と科学の受けと攻め。『織田信長の長槍』で風船を突ける?

4月18日(木曜日)、 時間は23時22分~24時22分、ABCテレビ「ナイトinナイト枠(木曜日)」の「ビーバップ!ハイヒール」で、『織田信長の長槍』で風船を突ける?日本史を科学的に検証!と題して、昨年集英社から出版した『信長もビックリ!? 科学でツッコむ日本の歴史』が放映されました。

歴史と科学を掛け合わせた内容です。つまりは、歴史と科学の受けと攻め。世の中にある多くの演算は、単純な掛け算と違って、演算の順番次第で内容が変わる気がします。歴史と科学では、一体どちらが前者でどちらが後者かはわかりません。

何はともあれ、動画で解説する「歴史×科学」は意外に相性良いのかも、と思わされました。…というか、わかりやすく説明しようとした時には、適切に作成された動画解説がわかりやすいのは当然なのかも、と思わされました。