2016-04-03[n年前へ]

■コンピュータが計算した流体シミュレーション結果の世界中にOculusを被って没入体験してみる!?

秋葉原を舞台に、(スカートをめくり上げてしまう)流体シミュレーションをOpenFOAMででした結果、コンピュータ中で計算された流体シミュレーション結果の世界に、VRヘッドセットのOculusを使って入り込んでみました。たとえば、試しにマネキンヘッドに計算流体世界に没入して眺めてみると、およそこんな感じです。

秋葉原を舞台に、(スカートをめくり上げてしまう)流体シミュレーションをOpenFOAMででした結果、コンピュータ中で計算された流体シミュレーション結果の世界に、VRヘッドセットのOculusを使って入り込んでみました。たとえば、試しにマネキンヘッドに計算流体世界に没入して眺めてみると、およそこんな感じです。

ちなみに、来週(勉強&遊びに行く)オープンCAE勉強会には、(優秀な若人から借りた)OculusDK2を持って行くつもりなので、そこでは秋葉原の流体シミュレーション世界に没入体験をすることができるはずです。

今やゲームエンジンが作り出す世界に入り込む(一見リアルに思える)体験を普通にすることができるようになりました、…だけど、それでも手元のコンピュータ中にいる…とても小さなCPU(中央処理装置)の出力結果の中に没入体験することができるというのは…何だかとても新鮮で楽しく感じます。

2016-04-09[n年前へ]

■「こどもごころに計算技術をトッピング」「計算世界をインタラクティブ/没入体験」

第56回オープンCAE勉強会@関東(流体など)の発表で使用したスライド(の一部)をここに置きました。発表した演目は、題して「こどもごころに計算技術をトッピング」「計算世界をインタラクティブ/没入体験」のチープ2本立て、です。

新宿のビルに囲まれた桜咲く公園のベンチに座り、周囲のビルの周りに吹く風を想像しながらパワポスライドを作り、ビルの中で話をして、ビル風の専門家からのアドバイスを受けるという面白い体験をする…のが、2016年の4月9日でした。

2016-04-10[n年前へ]

■フェルメールが描いた「天球儀」の中に没入して、その宇宙に浮かぶ「地球儀」を眺めてみよう!?

17世紀のオランダ画家ヨハネス・フェルメールが「地理学者」や「天文学者」で描いた「地球儀」や「天球儀」が展示されているBnF × DNP ミュージアムラボ 『フランス国立図書館 体感する地球儀・天球儀展』(五反田DNPミュージアムラボ)の、大日本印刷(DNP)がデジタル・スキャニングした3Dデータはフランス国立図書館(BnF)のデジタルアーカイブサイトGallicaにアクセスすると(そしてゴニョゴニョすると)、自分のコンピュータの中でも使えるようになります。

17世紀のオランダ画家ヨハネス・フェルメールが「地理学者」や「天文学者」で描いた「地球儀」や「天球儀」が展示されているBnF × DNP ミュージアムラボ 『フランス国立図書館 体感する地球儀・天球儀展』(五反田DNPミュージアムラボ)の、大日本印刷(DNP)がデジタル・スキャニングした3Dデータはフランス国立図書館(BnF)のデジタルアーカイブサイトGallicaにアクセスすると(そしてゴニョゴニョすると)、自分のコンピュータの中でも使えるようになります。

今日は、フェルメールが描いた「天球儀」の中に地球儀」を浮かべた上で、その世界の中に自分が入り、(ヘッドマウントディスプレイである)Oculus Riftで眺めてみました。下に貼り付けた動画は、過去の天球儀と地球儀の世界に入り込み(没入し)、Oculus を被った私が眺めている世界をWindow表示している映像例です。下の動画では、没入している感覚はありませんが、Oculusで眺めている本人は、左右視差の立体表示で眺める全方向に…過去の宇宙や地球(世界)が目に見え・没入している状態です。

過去に生きた人たちが考える世界(Armillary sphere)の中に没入し、その宇宙に浮かぶーその時代に考えられたー地球の姿を近くから、あるいは遠くから眺めるのは…とても楽しい体験です。

五反田DNPミュージアムラボでも、天球儀の中に入るVR展示はしていますが、こんな風に視点を変化させて眺めることはできなかったり、地球儀を同時に眺めたりすることはできません。…というわけで、フェルメールが描いた「天球儀」や「地球儀」を体験してみたい人は…フランス国立図書館(BnF)のデジタルアーカイブサイGallicaにアクセスしてデータをゴニョゴニョするのが良いかもしれません。

2016-04-11[n年前へ]

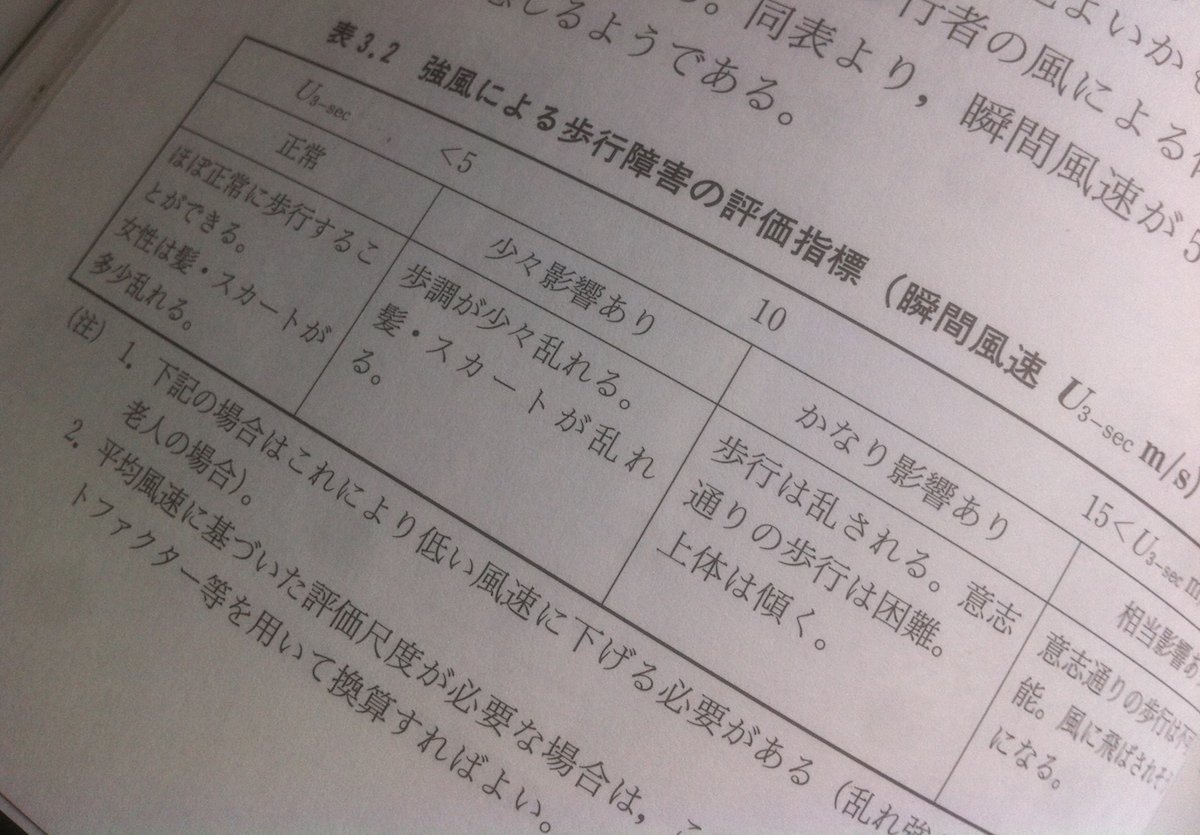

■ビル風が歩行者など人体に及ぼす影響(特に女性の髪とスカート限定)

昨年の今頃は、制服スカートがめくり上がる力は「ほぼ100〜150グラム重」で、風速でたとえると秒速10m弱…という法則を裏付ける実験経験をしていました(「風でスカートがめくれちゃう問題」を解いてみよう!?)。世の中で、もしもスカートをめくる風に関する「風速実験」「シミュレーション計算」「現象分析」の三題噺ならぬ三種競技があったなら…たぶん、日本で一番の経験(理解…とは違います)を持つ自信があります。…そんなことを考えながら、第56回オープンCAE勉強会@関東(流体など)に学び・遊び行くと、今野先生から「ビル風の基礎知識(風工学研究所)」に記載されている「歩行者に対する強風の影響とその評価尺度に関する研究」を教えてもらいました。

そこに書かれていたのは、「ビル風による弊害」の尺度を決めるための研究で、「傘の破損」や「転倒」といったよくありがちな問題に加えて、「女性の髪の乱れ」や「スカートの乱れ(多少乱れるとか、乱れるとか)」でした。さらに書けば、そこに書かれていたのは、秒速数mくらいの風が吹くと、女性のスカートが乱れる…という結果で、これまでの研究(計算&実験)を評価関数的にも裏付ける結果でした。

そうした実験をしてみると、「風でめくれるスカート」の科学!「涼しく晴れた朝の地下鉄駅をドジっ娘が走る」とスカートは必ずめくれる!?の法則に書いたように、秒速6〜10mくらいで、スカートがめくれ上がり始めるという…当たり前の結果になります。

2016-04-12[n年前へ]

■機械学習が作り出したレンブラント新作絵画を3D世界で眺めてみる!?

オランダ金融機関であるING グループとマイクロソフトが、「レンブラントの作風を表面の凹凸までコンピューターで再現する」新作品を機械学習で生成した上で、それ風のテクスチャ(3D形状)を作り出してUVインクジェットプリンタでプリントした…という”The Next Rembrandt”プロジェクトの成果が数日前に流れました。これは、レンブラントが1632年から1642年までに描いた、白い襟の黒い服を着た右向きの白人の顔の構図や配置(顔のパーツの位置関係比率)を機械学習で再現させて(色画像を眺めると”筆致を再現するスタイル行列的な処理はなされていないように見えます”)、生成された色画像の方向性(と高さ分布の対応)とレンブラントの時代の油絵において用いられていた色種毎の高さ(色重ね)ルールから作り出された画像のようです。

オランダ金融機関であるING グループとマイクロソフトが、「レンブラントの作風を表面の凹凸までコンピューターで再現する」新作品を機械学習で生成した上で、それ風のテクスチャ(3D形状)を作り出してUVインクジェットプリンタでプリントした…という”The Next Rembrandt”プロジェクトの成果が数日前に流れました。これは、レンブラントが1632年から1642年までに描いた、白い襟の黒い服を着た右向きの白人の顔の構図や配置(顔のパーツの位置関係比率)を機械学習で再現させて(色画像を眺めると”筆致を再現するスタイル行列的な処理はなされていないように見えます”)、生成された色画像の方向性(と高さ分布の対応)とレンブラントの時代の油絵において用いられていた色種毎の高さ(色重ね)ルールから作り出された画像のようです。

そこで、”The Next Rembrandt”サイトの説明用として使われている出力画像データから、レンブラントの新作を3D世界で眺めてみた例が上の画像です。こうして眺めてみると、レンブラントの新作というよりは、レンブラント風のレイアウトの画像に適当にテクスチャ(3次元形状)を付加したものにしか見えません。

しかし、それでは「そんなものはつまらない」かというと…そんなこともないような気がします。なぜならば、こういった処理は今や誰でも(多少のデータアクセスをして・少しのコードを書けば)作り出すことができるものであるからこそ、誰でも「レンブラント風の新作」を作り出すことができる(そして3D世界で”新作"絵画を眺めることもできる)…という面もあるからです。

2016-04-16[n年前へ]

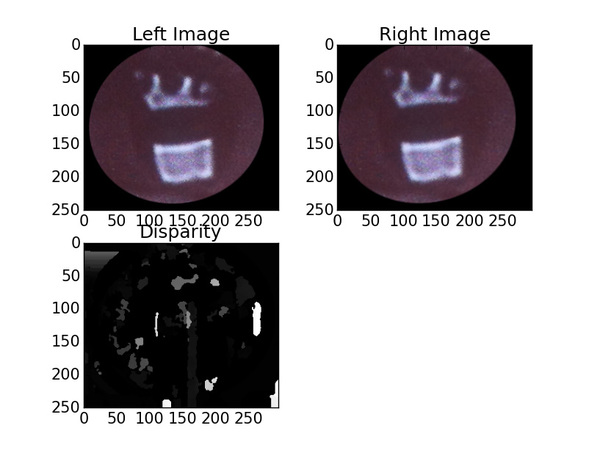

■両瞳に映り込んだ世界から3D世界を復元してみよう!?

政党ポスター中の三原じゅん子を見ると、その瞳に照明もしくは明るいレフ板が写り込んでいるようすがわかります。さすがに女優さんらしく、下部には大きな女優ライト風照明(もしくはレフ板)が使われているな…と思いながら、ふと「両目の表面に映り込む世界は、目の幅で配置された超魚眼カメラで撮影した世界だから、そのステレオカメラから(三原じゅん子さんが見た)立体世界を復元できないだろうか?」と考えました。

政党ポスター中の三原じゅん子を見ると、その瞳に照明もしくは明るいレフ板が写り込んでいるようすがわかります。さすがに女優さんらしく、下部には大きな女優ライト風照明(もしくはレフ板)が使われているな…と思いながら、ふと「両目の表面に映り込む世界は、目の幅で配置された超魚眼カメラで撮影した世界だから、そのステレオカメラから(三原じゅん子さんが見た)立体世界を復元できないだろうか?」と考えました。

そこで、三原じゅん子さんの左右両目の瞳表面に反射して見える魚眼世界を、適当に歪み補正した上で、両眼視差から距離マップを復元しよう!としてみたのが下図に示す結果です。…残念ながら、今回は「それっぽい」世界を得ることができませんでした。

2016-04-17[n年前へ]

■「レーウェンフックのスケッチ」と「フェルメールと印刷プロセス」

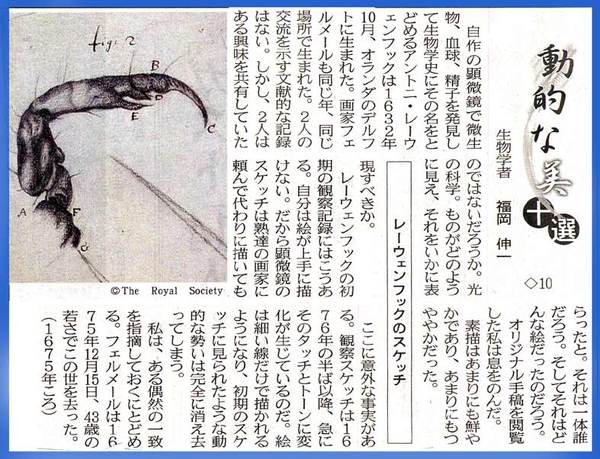

「レーウェンフックのスケッチは、あの画家フェルメールが描いたという説が!」というコメントを理科実験界隈で聞いた。それを聞いた時に考えたことを、少しここに書いてみる。

この「説」が流れ始めたのは、「あの」福岡伸一さんの影響だろうか、たとえば(ANAが出している雑誌記事で最初に見た気もするけれど)右に貼り付けたような新聞記事にもなっている。…けれど、この記事にはいくつもの疑問がある。福岡先生は、オリジナルの手稿(オリジナルの素描)の変遷を時代的に追えるほどに十分に見たのだろうか?とか、そもそもレーウェンフックが観察を行い・その記録を出版した多くの時代はフェルメールが亡くなってからだということはどう説明するのだろう?とか、そもそも「(当時は)熟練のーけれど油彩画ではなくてー別種の画家の力を借りるのが当然だった」ということに言及していないのはなぜだろう?といった疑問だ。

この「説」が流れ始めたのは、「あの」福岡伸一さんの影響だろうか、たとえば(ANAが出している雑誌記事で最初に見た気もするけれど)右に貼り付けたような新聞記事にもなっている。…けれど、この記事にはいくつもの疑問がある。福岡先生は、オリジナルの手稿(オリジナルの素描)の変遷を時代的に追えるほどに十分に見たのだろうか?とか、そもそもレーウェンフックが観察を行い・その記録を出版した多くの時代はフェルメールが亡くなってからだということはどう説明するのだろう?とか、そもそも「(当時は)熟練のーけれど油彩画ではなくてー別種の画家の力を借りるのが当然だった」ということに言及していないのはなぜだろう?といった疑問だ。

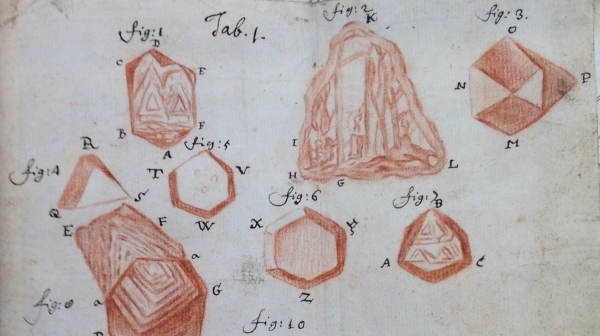

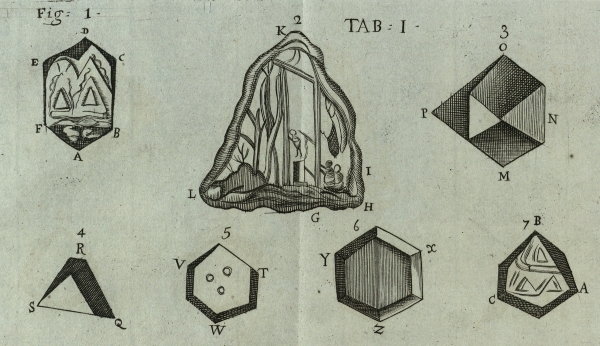

今現在眺めることができる「レーウェンフックが描いたスケッチ」というものは、多くのものが「レーウェンフックの自筆スケッチ」ではない。英国の王立学会(王立協会)の解説記事がわかりやすいけれど、現在「レーウェンフックのスケッチ」として眺めることができるほぼ全ての絵は「レーウェンフックの自筆スケッチとコメントを元にして銅版画家(油彩画画家ではなく)」が描いた上で印刷されたイラスト」だ。ちなみに、左下にはりつけたのは、王立学会解説記事で使われている希少なこれは希少なレーウェンフックの自筆スケッチで、右側はそれを銅版画家がトレースして(そのプロセスから必然として)反転すると同時に、(レーウェンフックの観察文言を元にして)銅版画家の想像力が作り出した銅版画化された世界だ。

当時の印刷プロセスを考えれば、その当時の時代技術を考えれば当然のことであるのだけれども、「描いた絵」をー銅版画家ーが描き直す必要があった。もちろん、そもそも「絵を描くこと」ができない研究者も多いので、(王立学会記事にしたがえば、”レーウェンフックの場合は、本人が元スケッチを描いた”けれど)他の研究者の場合にはー銅版画家に回す前にーまず最初の画家に描いて貰うことで=観察した研究者・イラストを描く画家・銅版画家…のトータル3人の感覚に描画技術を経て作り出されるのが普通だった。もちろん、当時は銅版画家が「想像で書く」ことも一般的だったので、レーウェンフックの自筆スケッチと観察文面とを踏まえて、銅版画家が想像力で加筆をすることも普通だった。つまり、「科学者が(銅版)画を描く技術が無いので、(銅版)画家に描いてもらう」ことは普通だった。

福岡伸一さんが書かれる一連の記事は、まるで小保方さんのように「人が欲しがるもの・ツボ」に通じていて…だから、そういうコメントが(興味を惹くために)理科実験界隈で出てくることについては…何か少し考えさせられてしまったりする。

2016-04-23[n年前へ]

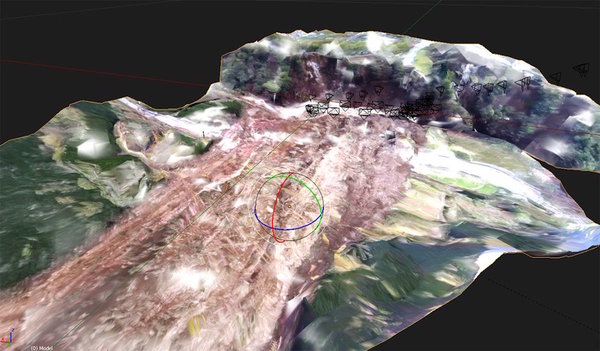

■国土地理院ドローンヘリ映像から、阿蘇大橋近くの3次元地形図を生成してみる…。

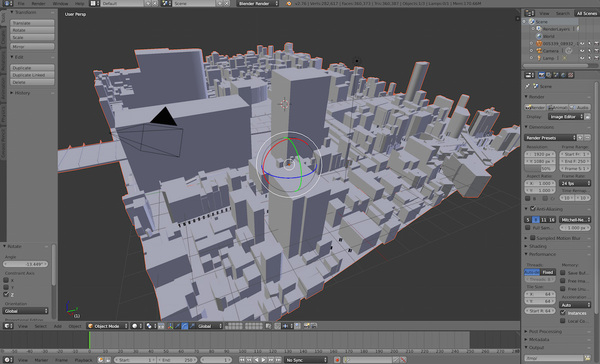

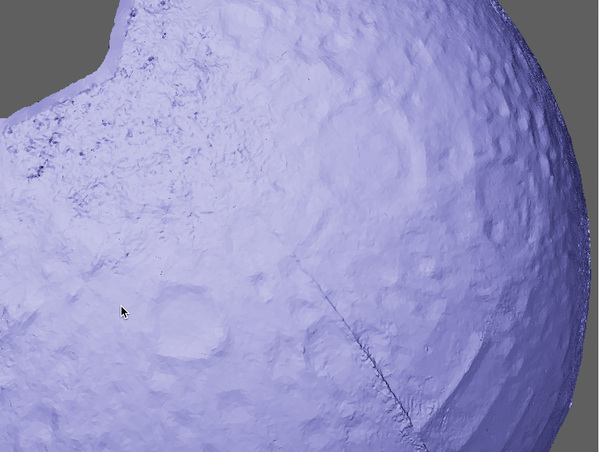

福岡県西方沖地震の後に、国土地理院がドローンヘリで撮影した動画を元にした3D地形図が公開されている。撮影動画自体もYoutubeで公開されているので、その動画を使って(自分でも)撮影されている風景の3次元形状復元をしてみた。たとえば、下のレンダリング画像は、得られた3次元メッシュを(モデラ・レンダラの)Blenderでレンダリングしてみたものだ。

また、自分で3次元形状を生成してやれば、さらに下に貼り付けたような(国土地理院が提供している3Dマップより)高解像度な形状を得ることもできる。そのようにして得られた3次元の世界を、たとえばヘッドマウントディスプレイ(HMD)で立体視したりすれば、土砂の流れもわかりやすく感じられる。

今や、簡易なフルカラー3次元空間程度のものであれば、スマホで撮影した動画や、TVで流れているような誰かが撮影した空撮動画などからでも、誰でも作れる時代だ。

2016-04-24[n年前へ]

■「かぐや」が眺めた月の姿を眺めてみよう!?

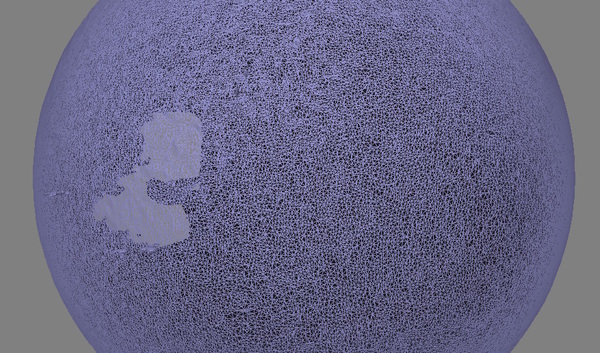

「かぐや」が撮影した画像データを使った月球儀コントローラがとても面白かったので、(国土地理院のドローンヘリが撮影した動画映像から、阿蘇大橋近くの3次元地形図を生成してみたのと同じように)かぐや撮影画像(©JAXA/SELENE)からphotogrammetry的に3次元メッシュ生成して表示してみました。WEBサイト(ソフト)で公開されている3Dレンダリングソフト画像をもとにして、月の表面に刻まれた、過去の月表面への衝突が作り出したクレーターの凹凸地図を今や誰でも描ける…というのは不思議な気分です。

「かぐや」が撮影した画像データを使った月球儀コントローラがとても面白かったので、(国土地理院のドローンヘリが撮影した動画映像から、阿蘇大橋近くの3次元地形図を生成してみたのと同じように)かぐや撮影画像(©JAXA/SELENE)からphotogrammetry的に3次元メッシュ生成して表示してみました。WEBサイト(ソフト)で公開されている3Dレンダリングソフト画像をもとにして、月の表面に刻まれた、過去の月表面への衝突が作り出したクレーターの凹凸地図を今や誰でも描ける…というのは不思議な気分です。

空の声が聞きたくて、風の声に耳すませ、

海の声が知りたくて、君の声を探してる。

「海の声」 篠原誠

2016-04-27[n年前へ]

■「(泡が下へ沈んでいく)ギネスカスケード」を近赤外線で撮影してみよう!?

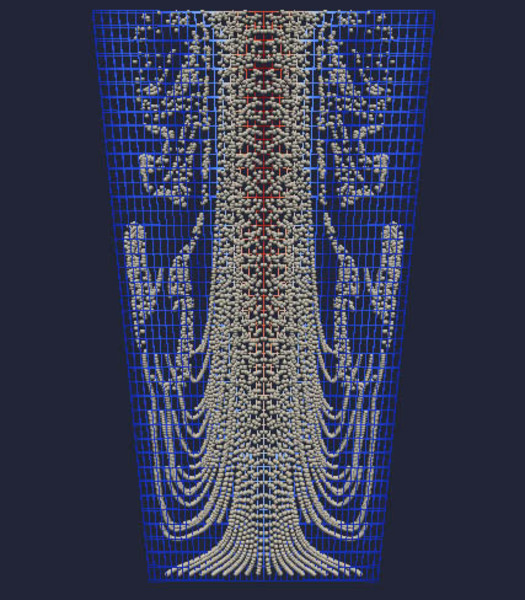

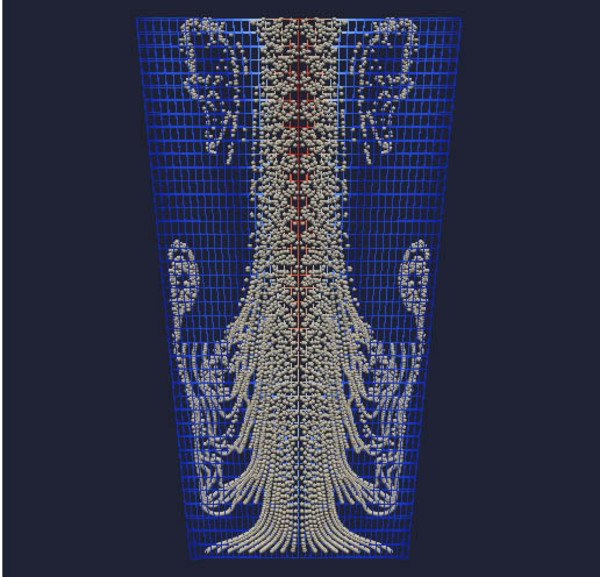

もう3年近く、知人のシミュレーション屋さんが「ギネスカスケード」シミュレーションを続けている。「ギネスカスケード」というのは、グラスに注いだギネスビールの泡が、下へ下へと静かに沈んでいく現象だ(参考:続 「ギネスビールの下に沈む泡」をOpenFOAMで計算してみよう!?)。この現象を、偏微分方程式ソルバのOpenFOAMで計算するだけでなく、(計算の信頼性を上げるべく)実験を比較している。

ただ、ほんのかすかに少しだけ残念なことに、実験撮影動画の方は、グラスの外部から見た・その表面から見える泡のようすしかわからない。なぜなら、濃い黒茶色のギネスビールでは、グラスの内部で何が起きているかはわからない。シミュレーション動画では、ギネスビールが注がれたグラスの内部挙動がわかる一方で(そういうことができるのがシミュレーションの良さでもある)、実験動画の方ではほんとうに外部表面のさましかわからないのが少し残念だ。

…というわけで、近赤外線カメラで「グラスにギネスビールを注いだようす」を撮影してみた。つまり、近赤外線の目で眺めれば、ギネスビールはほぼ完全に透明なので、グラス内部でどんな流体と窒素の泡の相互作用が起きているかを(シミュレーション動画と同様に)眺めることができる…というわけだ。下に貼り付けた動画は、透明なグラスに透明なサイダーのような炭酸飲料を注いでいるように見えるが、実際には透明なグラスに、(可視光では不透明で濃黒茶色の)ギネスビールを注いでいるようすである。

2016-04-30[n年前へ]

■続「(泡が下へ沈んでいく)ギネスカスケード」を近赤外線で撮影してみよう!?

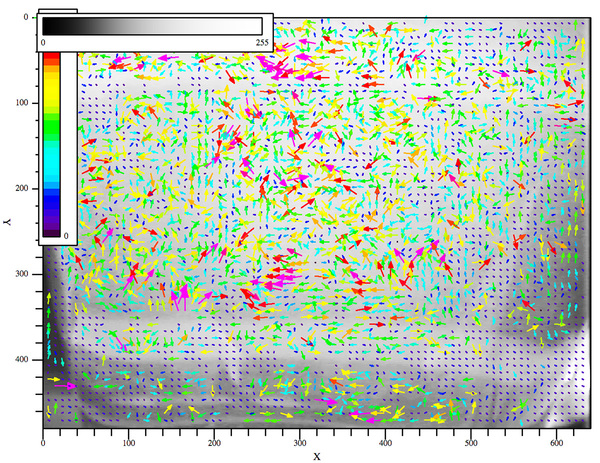

「(泡が下へ沈んでいく)ギネスカスケード」を近赤外線で撮影してみよう!?で、グラスに注いだギネスビールの泡が下へ下へと静かに沈んでいく「ギネスカスケード」を、近赤外線で撮影することで「可視光では見えないギネスビールの内側の泡の動き」を可視化してみました。今日は、撮影を再度行った上で、撮影した動画にParticle Image Velocimetry(PIV)を掛けて、速度場を出してみることにしました。

「(泡が下へ沈んでいく)ギネスカスケード」を近赤外線で撮影してみよう!?で、グラスに注いだギネスビールの泡が下へ下へと静かに沈んでいく「ギネスカスケード」を、近赤外線で撮影することで「可視光では見えないギネスビールの内側の泡の動き」を可視化してみました。今日は、撮影を再度行った上で、撮影した動画にParticle Image Velocimetry(PIV)を掛けて、速度場を出してみることにしました。

まず、今回再撮影した動画は、近赤外線カメラのピント位置をグラス中央にして、グラス中央断面の泡が(他の場所の泡に対して)写りやすいようにします。本来は、投光する近赤外線光もグラス中央断面にのみに平面状で当てることで、さらにグラス中央断面に沿った泡のみが写るようにしたいところですが、今回はカメラのピント位置調整だけを行いました。その状態で撮影したのが、下に貼り付けた動画です。ちなみに、撮影した場所は、右に貼り付けた画像のように、グラスの真ん中あたりの領域です。

まず、今回再撮影した動画は、近赤外線カメラのピント位置をグラス中央にして、グラス中央断面の泡が(他の場所の泡に対して)写りやすいようにします。本来は、投光する近赤外線光もグラス中央断面にのみに平面状で当てることで、さらにグラス中央断面に沿った泡のみが写るようにしたいところですが、今回はカメラのピント位置調整だけを行いました。その状態で撮影したのが、下に貼り付けた動画です。ちなみに、撮影した場所は、右に貼り付けた画像のように、グラスの真ん中あたりの領域です。

Youtubeにアップロードした動画では、画像圧縮のために泡が見えづらいですが、それでもグラス中央で立ち上る泡や、グラス端部に近い領域では沈降していく泡のようすが動画から見てとれます。泡の動きを描いた矢印の色は上下方向の速度を示していて、赤い色で描かれた矢印は上昇速度が速い泡が多い状態です。グラス中央では、上向きの赤い矢印が多い…つまり、グラス中央部では泡が上昇していることがわかります。

そこで、PIVにより描き出したギネスカスケード中の速度場のようすが、下に貼り付けた図です。(動画では視認される)グラス外周の泡沈降のようす抽出できていませんが、グラス中央で生じている泡が上昇しているさまは見えています。ギネスビールが可視光では黒茶色で不透明なために、不思議に見えるギネスカスケードですが、近赤外線で撮影した上で泡の動きの速度場を眺めてみると、自然で当然の現象であることがわかります。

そこで、PIVにより描き出したギネスカスケード中の速度場のようすが、下に貼り付けた図です。(動画では視認される)グラス外周の泡沈降のようす抽出できていませんが、グラス中央で生じている泡が上昇しているさまは見えています。ギネスビールが可視光では黒茶色で不透明なために、不思議に見えるギネスカスケードですが、近赤外線で撮影した上で泡の動きの速度場を眺めてみると、自然で当然の現象であることがわかります。